Después de que los testers se quejaran de falsas advertencias de choques y otros errores

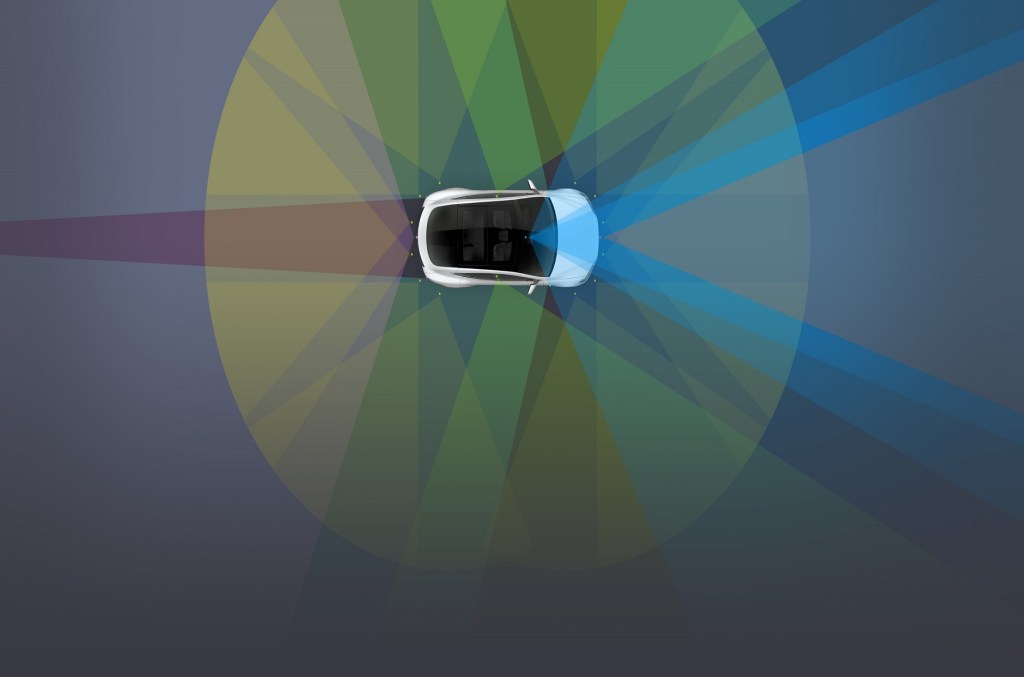

La decisión de Tesla de probar su software avanzado de asistencia al conductor “Full Self Driving” con propietarios de vehículos no capacitados en vías públicas ha atraído el escrutinio y las críticas, y eso fue antes de esta última versión.

La versión 10.3 comenzó a implementarse el sábado por la noche / domingo por la mañana con una larga lista de notas de la versión. La lista menciona cambios que comienzan con la introducción de perfiles de conductor que pueden cambiar entre diferentes características para la distancia de seguimiento, las paradas rodantes o la salida de los carriles de adelantamiento. Se supone que detecta mejor las luces de freno, los intermitentes y las luces de emergencia de otros vehículos, además de reducir las falsas ralentizaciones y mejorar la compensación para los peatones.

Sin embargo, el domingo por la tarde, Elon Musk tuiteó que Tesla «está viendo algunos problemas con 10.3, por lo que retrocede temporalmente a 10.2».

Si bien varios conductores ya han compartido videos e impresiones de su experiencia con el lanzamiento, ya sea que se alinee o no con lo que Tesla quiere que los participantes compartan en las redes sociales, los probadores dicen que la actualización de reversión elimina las capacidades beta de FSD de sus autos por completo.

Varios anuncios dijeron que la actualización 10.3 presenta advertencias de colisión frontal fantasma (FCW), otros problemas notados incluyeron la desaparición de la opción Autosteer, problemas de control de crucero consciente del tráfico (TACC) y pánico ocasional de AutoPilot. No está claro qué tan comunes son estos problemas y cuáles, en su caso, causaron la reversión, pero Musk respondió a un tweet sobre los problemas de Autosteer y TACC diciendo que la compañía está trabajando en ello .

Si es un problema común dentro del grupo de prueba, entonces un FCW fantasma ciertamente sería lo suficientemente serio como para iniciar una reversión. En 2019 hubo un retiro del mercado de Mazda3 para abordar problemas con el sistema de frenado inteligente que detecta objetos en el camino del automóvil de manera falsa. Si otro automóvil lo sigue de cerca, los vehículos que repentinamente pisan los frenos sin ningún motivo, como afirman varias publicaciones en las redes sociales, podrían causar fácilmente un accidente. Otro problema para los evaluadores es que varios afirmaron que los incidentes falsos de FCW redujeron su “puntaje de seguridad” calificado por Tesla lo suficientemente bajo como para que no pudieran permanecer en la versión beta.

Para cualquier persona preocupada por ser un miembro involuntario del grupo de prueba simplemente existiendo cerca de un Tesla utilizando software de trabajo en progreso, esto podría ser una señal de que la empresa está abordando los problemas rápidamente o un ejemplo de lo peligroso que es. Por otro lado, para los propietarios de Tesla que esperan que la prueba se amplíe para incluir a personas con un puntaje de seguridad más bajo, el hacker @greentheonly tuitea : “Para aquellos de ustedes con puntajes bajos que esperan el FSD: no lo hagan. Imagínese si condujera de la forma en que lo requiere la aplicación, sería horrible, ¿verdad? ¡Pero el coche conduce aún peor! Es totalmente inutilizable en cualquier tipo de tráfico y en carreteras estrechas, los videos no le hacen justicia «.

Descubre más desde TecnoAp21

Suscríbete y recibe las últimas entradas en tu correo electrónico.

Categorías:Movilidad eléctrica, Noticias, Secciones temáticas